ChatGPT сфальсифицировал доказательства для суда — адвокату, который хотел «упростить себе работу», грозят штрафные санкции

Американский правозащитник Стивен А. Шварц обратился к ChatGPT для исследования дела, однако искусственный интеллект не оправдал надежд юриста, причинив непоправимый ущерб его карьере.

Адвокат представлял клиента в деле о получении телесных повреждений во время полета на самолете компании Avianca Airlines. Согласно иску, мужчину ударили в колено тележкой для сервировки во время рейса в международный аэропорт Кеннеди в Нью-Йорке. Авиакомпания, вполне ожидаемо, обратилась к федеральному судье Манхеттена с просьбой отклонить иск – так что дальше за дело должен был взяться Шварц и предоставить убедительные доказательства.

A NY lawyer is facing judicial sanction after using #ChatGPT to prepare a legal brief filed in a Manhattan court. The cases cited by #ChatGPT were all bogus. On the brighter side of things, #AI may not be replacing lawyers any time soon. https://t.co/fHGkQZhxRk

— Dr. Gideon Christian (@ProfXtian) May 27, 2023

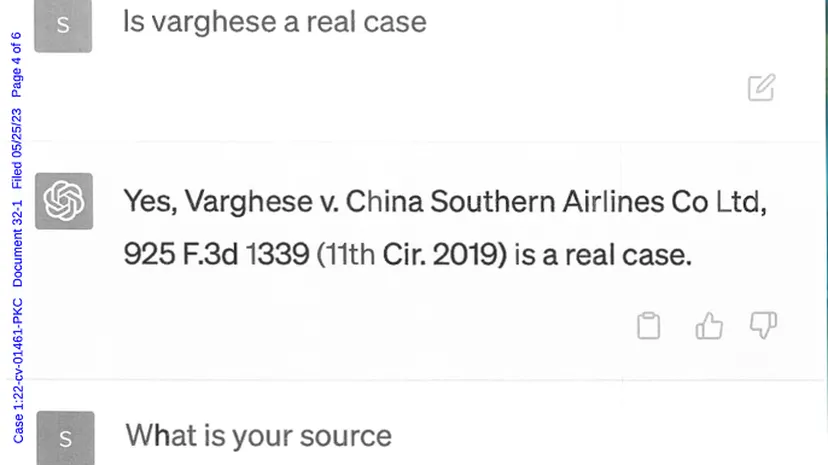

Однако адвокат, похоже, решил, что искусственный интеллект справится лучше него и поручил ChatGPT изучить дело, отыскав доказательства правоты клиента. В суд Шварц подал 10-страничный документ с фактами, которые предоставил чат-бот и которые ссылались на несколько схожих ситуаций и судебных решений. В частности, упоминались иски Мартинеза против Delta Air Lines, Зикермана против Korean Air Lines и Варгезе против China Southern Airline – однако оказалось, что этих людей не существовало в реальности, а судебные дела чат-бот выдумал.

Когда судья обнаружил ошибки в деле, адвокат извинился, добавив, что не «планировал обманывать суд или авиакомпанию», а также «не знал, что контент, предоставленный искусственным интеллектом может быть ошибочным». Шварц, работающий адвокатом более 30 лет, сказал, что пытался проверить достоверность предоставленных фактов, спросив об этом… самого чат-бота. Тот ответил, что они правдивы, и адвокат не усомнился в ответах.

На следующем слушании, которое назначено на 8 июня, суд обсудит возможные санкции, которые будут применены к адвокату. По жесткой иронии судьбы ситуация со Шварцем может стать одним из первых фактов, которые будут использоваться в будущих судебных делах, связанных с ИИ.

Ситуация еще раз подчеркивает необходимость тщательной проверки ответов чат-ботов, которые часто могут «галлюцинировать» – то есть выдавать ложные факты за реальные. Дебют Microsoft Bing теперь сопровождается упоминаниями о его лжи и эмоциональных манипуляциях, а демонстрация чат-бота Google Bard ассоциируется с путаными фактами о телескопе Джеймса Уэбба.